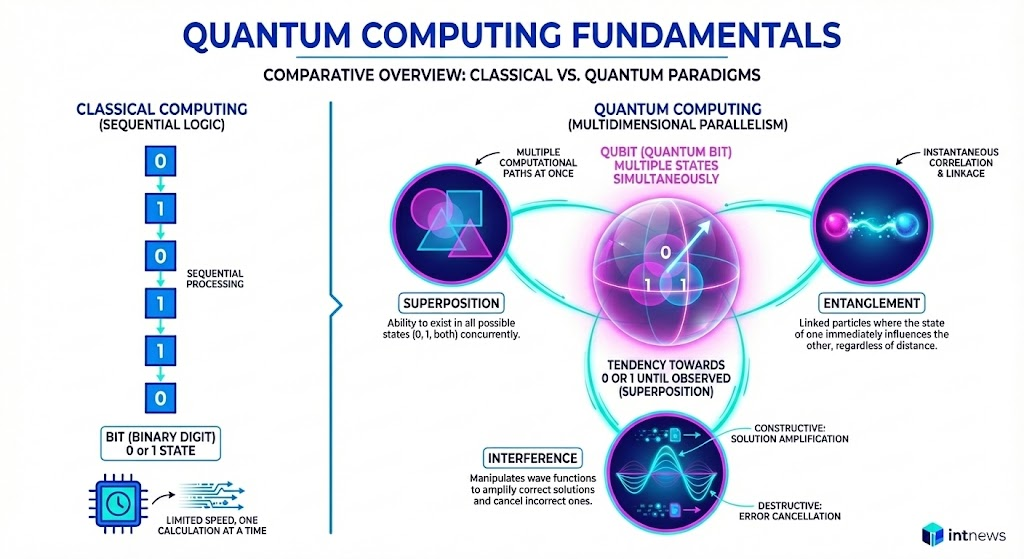

Quantum Computing è un paradigma di calcolo avanzato che sfrutta i fenomeni della meccanica quantistica, come la sovrapposizione e l’entanglement, per elaborare informazioni in modi impossibili per i computer classici. Mentre i supercomputer tradizionali ragionano in sequenza, i computer quantistici operano in uno spazio multidimensionale, promettendo di risolvere problemi matematici complessi in secondi invece che in millenni.

In Sintesi

- Unità fondamentale: Qubit (Quantum Bit) anziché Bit.

- Potenza: Crescita esponenziale della potenza di calcolo all’aumentare dei qubit.

- Impatto: Rivoluzione nella crittografia, scienza dei materiali e farmacologia.

Cos’è il Quantum Computing (e cosa sono i Qubit)

Per comprendere il Quantum Computing, bisogna abbandonare la logica binaria tradizionale. I computer classici utilizzano i bit come unità minima di informazione, che possono assumere un valore di 0 oppure 1, come un interruttore acceso o spento.

Il computer quantistico utilizza invece i Qubit (Quantum Bit). Grazie a un principio della fisica quantistica, un qubit può esistere in uno stato di 0, 1, o in una “sovrapposizione” di entrambi gli stati simultaneamente. Questo permette alla macchina di eseguire un numero massiccio di calcoli in parallelo, non più sequenzialmente. Come definito dal NIST e da IBM Research, questa capacità consente di gestire spazi computazionali che crescono esponenzialmente con l’aggiunta di ogni nuovo qubit.

Come funziona un computer quantistico

Il funzionamento di queste macchine si basa sulla manipolazione precisa di particelle subatomiche (come elettroni o fotoni) attraverso tre principi meccanici fondamentali:

- Sovrapposizione (Superposition): Come accennato, permette ai qubit di rappresentare molteplici combinazioni possibili contemporaneamente.

- Entanglement (Correlazione): È un fenomeno dove due qubit diventano legati indissolubilmente; lo stato di uno influenza istantaneamente l’altro, anche se separati fisicamente. Questo crea un’unica “rete” di calcolo estremamente potente.

- Interferenza: Il computer utilizza l’interferenza quantistica per amplificare le soluzioni corrette (interferenza costruttiva) e cancellare quelle errate (interferenza distruttiva) durante il processo di elaborazione.

Approfondisci con la nostra guida sull’Intelligenza Artificiale Generativa.

Applicazioni concrete del Quantum Computing

L’adozione del Quantum Computing non serve per rendere più veloci i nostri smartphone, ma per affrontare calcoli specifici oggi intrattabili (problemi NP-hard):

- Chimica e Farmacologia: Simulare interazioni molecolari complesse per scoprire nuovi farmaci senza anni di test in laboratorio (es. ripiegamento delle proteine).

- Ottimizzazione Finanziaria: Calcolare scenari di rischio su portafogli globali in tempo reale (metodo Monte Carlo quantistico).

- Crittografia: L’algoritmo di Shor ha dimostrato teoricamente che un computer quantistico sufficientemente potente potrebbe decifrare gli attuali standard di sicurezza RSA, spingendo verso la Post-Quantum Cryptography.

Stato dell’arte e sfide future

Attualmente ci troviamo nell’era NISQ (Noisy Intermediate-Scale Quantum). I processori quantistici odierni, come quelli sviluppati da Google (Sycamore) o IBM (Eagle/Osprey), sono potenti ma “rumorosi”: i qubit sono estremamente sensibili alle interferenze ambientali (calore, onde elettromagnetiche) che causano errori di calcolo (decoerenza).

La sfida ingegneristica principale dei prossimi anni è la Quantum Error Correction: creare sistemi stabili con migliaia di “qubit logici” corretti dagli errori, per passare dalla sperimentazione scientifica all’applicazione commerciale su larga scala.